Bunter Teller 3

Künstliche »Intelligenz«

Künstliche Intelligenz (KI oder AI für »Artificial Intelligence«) ist das Trendthema dieser Zeit. Kaum ein Software-Unternehmen, das nicht mit diesen Assistenzsystemen rumexperimetiert. Die Ergebnisse sind durchwachsen. Im Grafik- und Videobereich lassen sich damit auch ganz nette Ergebnisse erzielen wie zum Bespiel das Seitenlogo oben links, doch selbst bei konkreter Beschreibung der Anforderungen bleibt so ein Assistent oft stur. Auch beim Suchen im unüberschaubaren Netz kann KI gute Dienste leisten, aber sonst?

Man kann mir wirklich nicht nachsagen, ich sei altmodisch oder hafte am Erlernten, aber den Ergebnissen der sog. Künstlichen Intelligenz zu anspruchsvolleren Aufgaben begegne ich mit deutlicher Skepsis, und das nicht ohne Grund. Ich publiziere hier meine teils ärgerlichen, teils amüsanten Erfahrungen bei passenden Gelegenheiten.

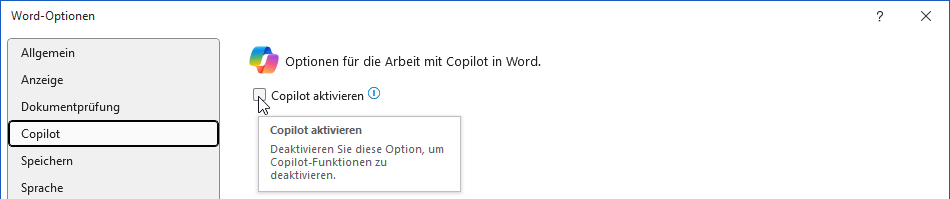

Microsoft hat Copilot zum Bestandteil von Microsoft 365 gemacht.

In einer Nacht-und-Nebel-Aktion hat Microsoft am 17. Januar 2025 die Office-Abonnements-Version Microsoft 365 mit der KI Copilot erweitert. Der Nutzen ist zweifelhaft, die Mehrkosten erheblich, wenn man nicht bei der nächsten Abo-Verlängerung auf Microsoft 365 Classic downgraded. Zu empfehlen ist das Downgrade, denn überzeugen kann diese Ergänzung nicht. Hier ein paar Beispiele für Word.

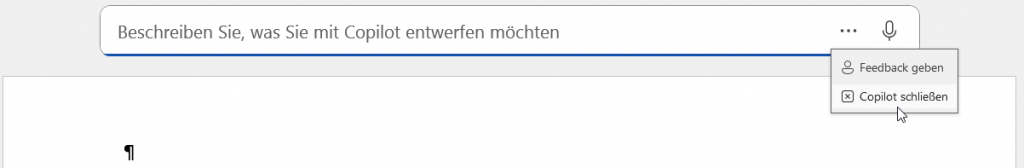

Öffnen Sie Word mit einem leeren Dokument, drängt sich sofort der Copilot auf:

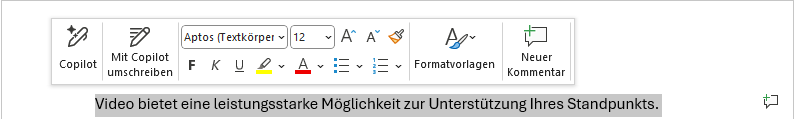

Nun dürfen Sie aber nicht denken, mit einem Klick auf Copilot schließen hätte der Spuk ein Ende. Permanent steht links von der Zeile, in der sich die Schreibmarke gerade befindet, das Icon des Copiloten. Haben Sie Text markiert, erscheint es in der Minisymbolleiste.

Nun kann man das natürlich ignorieren und sofort drauflos schreiben, doch bei jedem Betätigen von R ploppt links neben dem Text wieder das Icon auf, um seine zweifelhaften Dienste aufzudrängen.

Update:

Ursprünglich konnte man Copilot in einigen Office-Varianten nicht abschalten. Endlich wurde dieser Bug behoben.

Was kann Copilot außer zu stören?

Kommen wir nach diesen formalen Mängeln zur Leistungsfähigkeit und stellen eine (vermeintlich) leichte Aufgabe.

Unter einem »qualitativ hochwertigen« Inhalt stelle ich mir aber was anderes vor. Also gut, machen wir es einfacher:

»Danke, Sie hören von uns.« 🤣

Update 24.02.25: Das mit dem Blindtext klappt jetzt schon besser, nur mit der Sprache hapert’s noch.

Schlimmer noch: Die KI versteht sich selbst nicht.

Ist Microsofts »Copilot« Legastheniker?

Einfach nur zum Testen der Autorenfähigkeiten erteilte ich Copilot den Auftrag, eine Rezension zu Tuhls’ Tools zu schreiben. Das sollte zu schaffen sein, sind doch alle Informationen über das AddIn hier konzentriert abrufbar. Inhaltlich stimmte es auch einigermaßen, aber an einigen Stellen wurde ich stutzig. Braucht der Copilot ’ne Lesebrille? Für virtuelle Texte? Wie sonst könnte man diese Verkorksung von »Hoppelformatierungen« und »Anführungszeichen« wohl deuten?

KI auf der Suche nach dem Apostroph

Ich dachte mir, versuch es doch mal mit einer einfachen Aufgabe.

Das ist eine CH-Tastatur, die Apostroph-Taste ist markiert:

Nun kam ich auf die abwegige Idee, dieselbe Aufgabe Microsofts Copiloten zu stellen. Das Ergebnis:

Auf der Schweizer Tastatur liegt der Apostroph (‚) auf der gleichen Taste wie das „@“-Zeichen. Um den Apostroph zu schreiben, drücken Sie die Umschalttaste (Shift) und die Taste, auf der sich das „@“-Zeichen befindet (in der Regel die Taste mit der Zahl 2).

Hochinteressant, das wollte ich doch mal sehen und gab im Copilot-Aufgabenbereich den Auftrag:

»Generate an image of apostroph key on a swiss keyboard.«

Das Ergebnis beim besten Willen nicht überzeugen.

Also gut, dann fragen wir doch mal das Original ChatGPT:

Fazit: Selbst simple, faktisch leicht nachprüfbare Sachverhalte bringt keine KI auf die Reihe.

Und für so etwas werden Nutzungsgebühren verlangt?

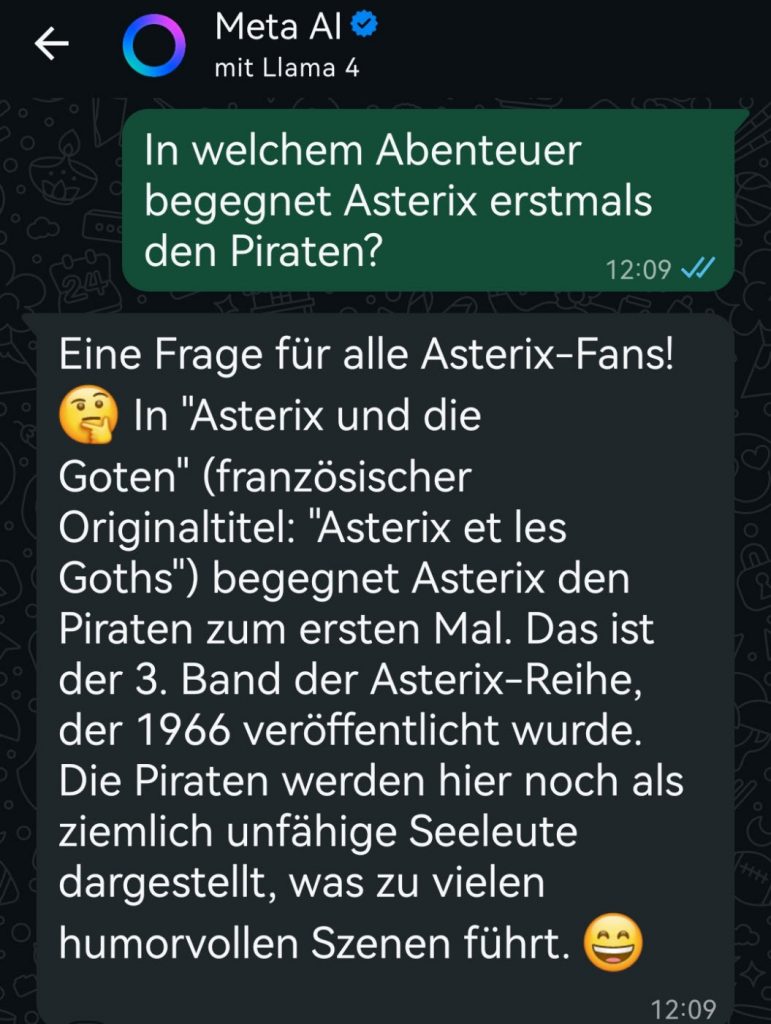

KI schreiben Asterix um

Details zu weltweit bekannten Themen sollten sich leicht finden lassen, wenn die KI freien Zugriff auf die Daten der Welt hat … denkt man. ChatGPT schreibt einfach ein neues Kapitel, von dem noch nie jemand etwas gehört hat (Bild rechts).

Aber auch andere KI tun sich schwer mit den unbeugsamen Galliern; so widerspricht sich Aria in seiner Antwort (Bild unten) und Copilot iterierte sich nach mehreren Hinweisen auf die falsche Nummer an das richtige Heft 4 heran.

Update November 2025:

Die oben dargestellten Tests funktionieren mittlerweile besser, meist wird korrekt Band 4 angegeben. Am Lerneffekt scheint also doch etwas dran zu sein.

Aber es gibt noch Ausreißer, wie der Test mit Meta AI zeigt (Bild rechts). Auch das Erscheinungsdatum ist falsch: »Asterix und die Goten« erschien in Frankreich erstmals 1963, in Deutschland 1970 als Band VII.

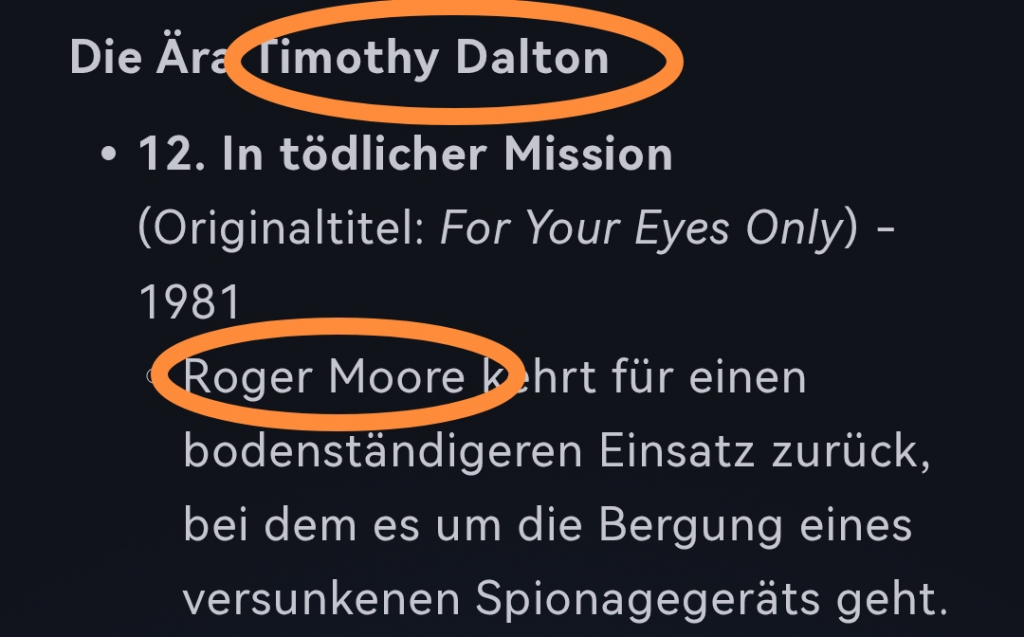

KI sucht James Bond

Ich war im Zweifel über dir korrekte Reihenfolge der James-Bond-Filme und dachte mir, lass doch eine KI suchen.

Ok, die Reihenfolge stimmte, nicht aber die Hauptdarsteller, was bei einem Eintrag besonders auffällig war. Von einer Künstlichen Intelligenz erwarte ich, dass solche Plausibilitätsfehler erkannt werden.

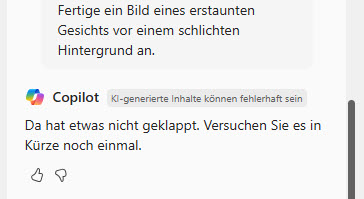

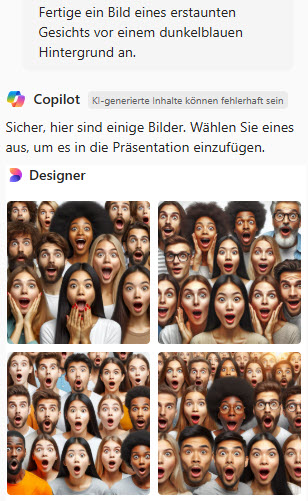

Was an »einfarbiger Hintergrund« ist so schwer verständlich?

Zur Illustration der Rubrik »Bunter Teller« ließ ich mir vom Copiloten in PowerPoint helfen. Die Ergebnisse waren durchaus passabel, aber in einem Fall war es partout nicht möglich, ein Gesicht mit einfarbigem Hintergrund zu erhalten. Auch auf Nachbesserungswünsche reagierte Copilot nicht, sondern bastelte neue Bilder mit viel Hintergrund (siehe unten). Copilot scheint durch nichts zum Verzicht auf einen bunten Hintergrund zu bewegen zu sein.

Das letztendlich verwendete Bild stammt zwar von Copilot, wurde aber manuell nachgearbeitet.